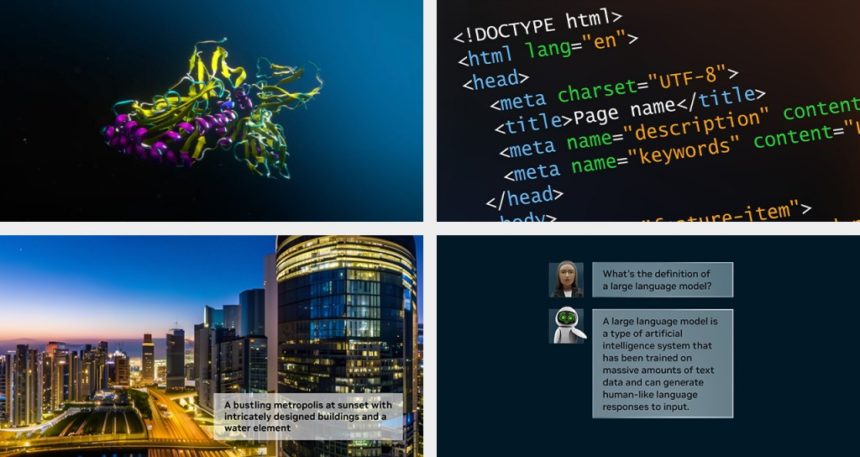

Jakarta, Gizmologi – Penyedia layanan multi-cloud kelas enterprise, VMware resmi menjalin kemitraan strategis dengan Nvidia. Kolaborasi keduanya menghadirkan solusi VMWare Private AI Foundation dalam mengaplikasikan kecerdasan buatan

CEO, VMware Raghu Raghuram mengatakan, platform yang dibangun berdasarkan infrastruktur awan dari VMWare ini dapat melakukan kustomisasi model dan menjalankan aplikasi AI generatif. Solusi terintegrasi ini menghadirkan software AI generatif, yang dapat memproses layanan chatbot, asisten pintar, bahkan meringkas data komputasi.

“AI generatif dan multi-cloud merupakan pasangan yang sempurna. Data pelanggan ada di mana-mana – di pusat data mereka, di edge, dan di cloud,” ungkap Raghu dalam keterangan resminya, Kamis (24/8/2023).

Melalui kemitraan ini pula VMware Private AI Foundation akan memungkinkan pihak enterprise untuk melakukan kustomisasi model bahasa yang lebih luas. Termasuk memproduksi lebih banyak model AI yang aman dan terkendali untuk keperluan internal perusahaan maupun konsumen.

Platform ini diharapkan bisa menyertakan perangkat AI terintegrasi untuk memberdayakan perusahaan-perusahaan dalam menjalankan model-model yang sudah teruji yang dilatih pada data pribadi mereka dengan cara yang hemat biaya. Apalagi layanan ini dibangun di atas VMware Cloud Foundation dan perangkat lunak Nvidia AI Enterprise.

“Bersama dengan NVIDIA, kami akan memberdayakan perusahaan-perusahaan untuk menjalankan beban kerja AI generatif mereka yang berdekatan dengan data mereka dengan penuh percaya diri sambil mengatasi masalah privasi, keamanan, dan kontrol data perusahaan mereka,” paparnya.

Platform ini akan menampilkan Nvidia NeMo, sebuah kerangka kerja end-to-end, cloud-native yang disertakan dalam Nvidia AI Enterprise – sistem operasi platform Nvidia AI – yang memungkinkan perusahaan untuk membangun, mengkustomisasi, dan menggunakan model-model AI secara virtual di mana saja.

Baca Juga: Nvidia Rilis GPU Workstation RTX Series

Layanan Multi Cloud VMware Private AI

NeMo menggabungkan kerangka kerja kustomisasi, perangkat pagar pembatas, perangkat kurasi data, dan model yang sudah terlatih untuk menawarkan kepada perusahaan cara yang mudah, hemat biaya, dan cepat untuk mengadopsi AI generatif. NeMo menggunakan TensorRT untuk Large Language Models (TRT-LLM), di mana ini mampu mempercepat dan mengoptimalkan performa inferensi pada LLM terbaru pada GPU Nvidia.

“Perusahaan-perusahaan di seluruh dunia berlomba untuk mengintegrasikan AI generatif ke dalam bisnis mereka,” kata Jensen Huang, pendiri dan CEO, Nvidia.

Menurut Jensen, kolaborasi ini akan memperluas jangkauan VMware yang telah memiliki ratusan ribu pelanggan di seluruh layanannya. Sehinggan kombinasi perangkat lunak dan komputasi yang lengkap dapat membuka potensi AI generatif.

Rencananya, platform VMware Private AI Foundation with Nvidia akan didukung oleh Dell Technologies, Hewlett Packard Enterprise dan Lenovo – yang akan menjadi yang pertama menawarkan sistem yang mampu meningkatkan kustomisasi LLM perusahaan dan beban kerja inferensi dengan GPU Nvidia L40S, Nvidua BlueField®-3 DPU dan Nvidia ConnectX®-7 SmartNIC.

Eksplorasi konten lain dari Gizmologi.id

Berlangganan untuk dapatkan pos terbaru lewat email.